Twój koszyk jest obecnie pusty!

CEO OpenAI zapowiedział codzienne livestreamy z prezentacjami i demami – jak sam określił, „some big ones and some stocking stuffers” (niektóre większe, inne jako wypełniacze świątecznych skarpet). „Samta Claus is coming to town? 🎅🎅🎅” – zareagowała społeczność, a internet natychmiast zawrzał od spekulacji na temat tego, co kryje się w technologicznym worku OpenAI.

1/12 – Model o-1 (05.12.2024 r.)

Pierwszego dnia świątecznego maratonu OpenAI nie zawiodło oczekiwań, prezentując pełny model o-1 wraz z nowym planem subskrypcyjnym ChatGPT Pro. To znaczące rozszerzenie możliwości względem wersji preview, szczególnie w obszarze szybkości działania oraz zdolności do rozwiązywania złożonych zadań matematycznych i programistycznych.

ChatGPT Pro – nowa propozycja dla wymagających użytkowników

Największą niespodzianką jest wprowadzenie planu ChatGPT Pro w cenie 200 USD miesięcznie. Co otrzymują subskrybenci? Przede wszystkim nielimitowany dostęp do najnowszej rodziny modeli, w tym:

- o1

- o1-mini

- GPT-4o

- Zaawansowany asystent głosowy

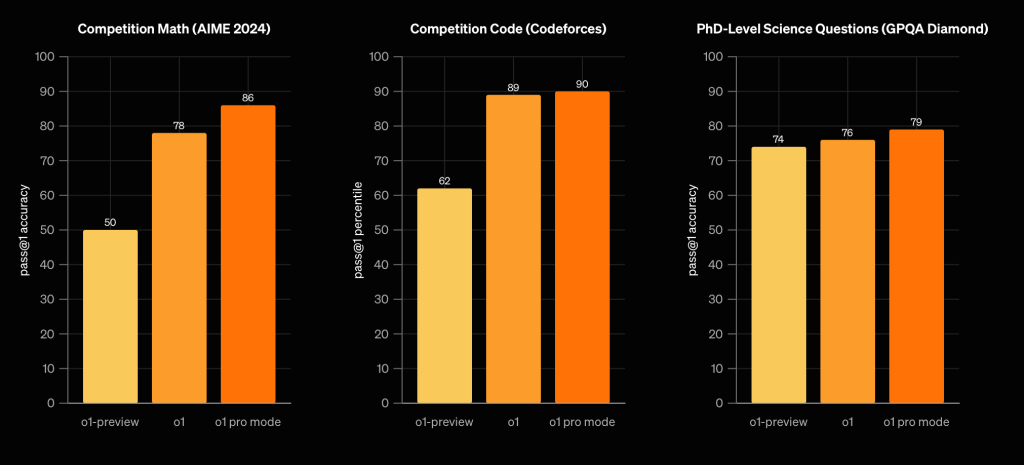

Kluczową funkcją jest tryb „pro mode”, który pozwala modelowi na dłuższe „zastanowienie się” nad odpowiedzią. Rezultaty są imponujące – w testach porównawczych model osiąga znacząco lepsze wyniki niż standardowa wersja:

- Matematyka na poziomie AIME 2024: 86% skuteczności (poprawa o 8 punktów procentowych)

- Programowanie (benchmarki Codeforces): 90% skuteczności

- Analiza naukowa na poziomie doktorskim: 79% poprawnych odpowiedzi

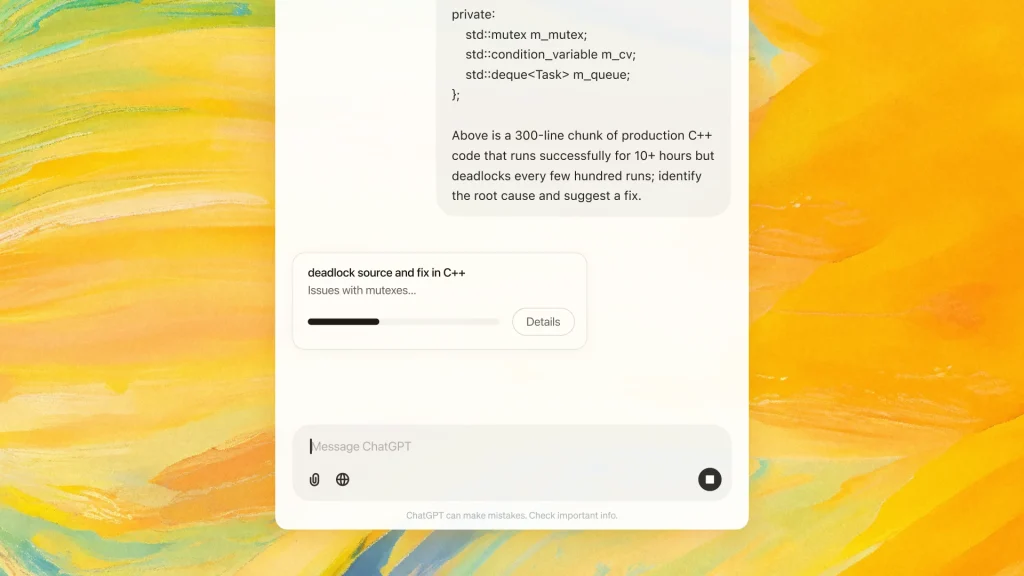

W porównaniu do aktualnego modelu o-1 Preview, wersja pro wymaga więcej czasu na „myślenie”, przez co potrzebuje więcej czasu na wygenerowanie odpowiedzi. W tym celu, użytkownicy Pro otrzymają specjalny pasek z postępem „zastanawiania się” przez sztuczną inteligencję. Dodatkowo, pytający dostanie powiadomienie, jak tylko model wygeneruje gotową odpowiedź.

Wsparcie dla nauki

OpenAI nie zapomina o społeczności naukowej. Firma ogłosiła program grantowy, w ramach którego 10 badaczy medycznych z czołowych amerykańskich instytucji otrzyma darmowy dostęp do planu Pro. Wśród beneficjentów znaleźli się m.in. specjaliści zajmujący się badaniami nad chorobami rzadkimi i demencją.

2/12 – Finetuning o-1 z RL (06.12.2024 r.)

Sam Altman kontynuuje atmosferę „emejzingu” określając dzisiejszą prezentację „największą niespodzianką w 2024 roku”. Choć Sam był nieobecny podczas streamu, to na X (dawnym Twitterze) skomentował, że nie może doczekać się, jak zobaczy co użytkownicy stworzą. O co chodzi?

Reinforcement Learning (RL) z modelami z serii o-1

Przedstawiciele firmy OpenAI na dzisiejszym spotkaniu zapowiedzieli wprowadzenie możliwości samodzielnego finetuningu modeli z serii o-1 w oparciu o Reinforcement Learning (RL). Dotychczas ta metoda była dostępna wyłącznie wewnętrznie. Wcześniej użytkownicy mogli dostrajać modele jedynie za pomocą Supervised Learning.

Dzięki dostrojeniu mniejszego modelu, np. o-1 mini, do specyficznego zadania, możliwe będzie osiągnięcie wyników lepszych niż w większych modelach, takich jak o-1. Przy tuningu modeli, będziemy mogli wytrenować ekspercką sztuczną inteligencję, która nie wymaga zbyt dużo danych treningowych. Oznacza to nie tylko większą efektywność, ale również niższe koszty.

Wersja alfa zostanie udostępniona już teraz dla wybranych badaczy, ale szerszy dostęp będzie możliwy w pierwszym kwartale 2025 roku.

3/12 – Sora (09.12.2024 r.)

Trzecie odkrycie ujawniło przed nami Sorę – ulepszony model AI, który umożliwia generowanie realistycznych i kreatywnych filmów na podstawie tekstowych opisów. Sora potrafi tworzyć filmy o długości do 20 sekund, zachowując wysoką jakość wizualną i spójność z opisem użytkownika. Technologia ta nie tylko generuje animacje, ale symuluje także złożone zjawiska z rzeczywistego świata, takie jak ruchy postaci, zmiany w otoczeniu czy interakcje między obiektami.

Odświeżona Sora już dostępna. Jak narzędzie działa w praktyce?

Wraz z debiutem nowego modelu Sora Turbo, OpenAI przygotował również bardziej dopracowany interfejs, który pozwala na znacznie bardziej rozbudowane opcje do generowania materiałów wideo. Według zapewnień Sama Altmana i jego współpracowników, narzędzie jest dostępne dla wszystkich użytkowników płatnych planów Plus oraz Pro (z wyjątkiem użytkowników z Unii Europejskiej). W ramach tańszej subskrypcji, użytkownicy mogą generować do 50 filmów w rozdzielczości 480p lub nieco mniej filmów w rozdzielczości 720p miesięcznie. W droższym planie do dyspozycji mamy 10 razy lepsze możliwości, w tym wyższa jakość 1080p oraz dłuższe materiały filmowe.

Firma zapowiedziała również, że trwają prace nad lepszym dostosowaniem cennika, tak, by każdy z nas – z wyjątkiem mieszkańców UE i UK – mógł korzystać z Sory w przystępnej cenie.

4/12 – Canvas (10.12.2024 r.)

Po spektakularnym debiucie Sory, nadszedł czas na mniejsze, ale równie przydatne usprawnienie. Sam Altman nazwał je „stocking stuffers” – drobnymi prezentami świątecznymi. Przedstawiamy Canvas, funkcję, która może odmienić sposób pracy z ChatGPT.

Canvas był już wcześniej dostępny w wersji beta dla użytkowników planów Plus i Team, ale teraz trafił do wszystkich planów ChatGPT. Jakie nowe możliwości przynosi?

Edycja tekstu bezpośrednio w oknie ChatGPT

Canvas pozwala na wprowadzanie poprawek w wybranych fragmentach tekstu, bez konieczności przenoszenia go do zewnętrznych edytorów. Możesz stosować kursywę, pogrubienia czy dodawać komentarze do konkretnych fragmentów. Co więcej, funkcja umożliwia zastosowanie wskazówek wynikających z komentarzy w czasie rzeczywistym – wystarczy jedno kliknięcie. Idealne rozwiązanie dla autorów i redaktorów!

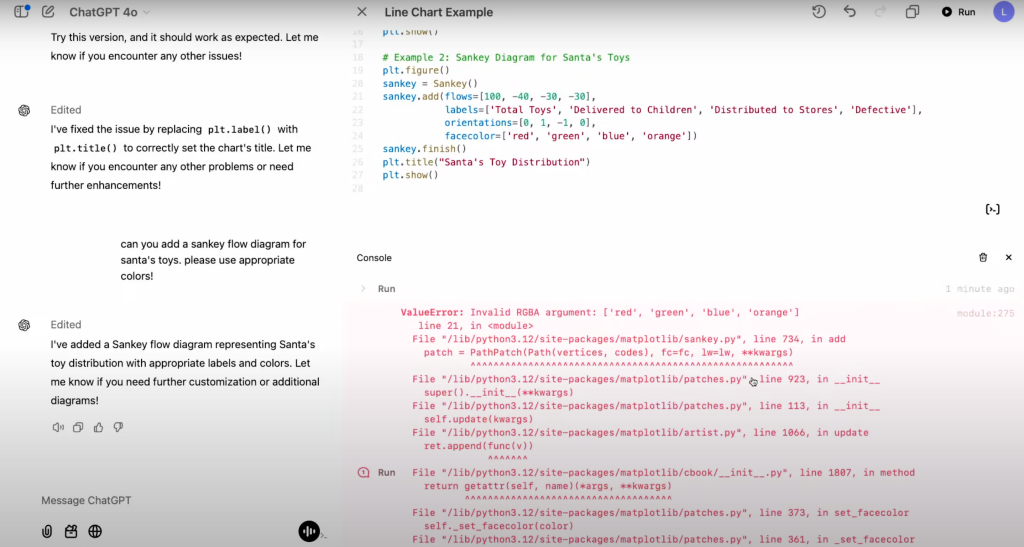

Wbudowany edytor kodu

Canvas to także ukłon w stronę programistów. W nowym edytorze można pisać, uruchamiać i poprawiać kod. Funkcja „Fix bug” umożliwia natychmiastową korektę błędów, co czyni Canvas bezpośrednią konkurencją dla narzędzi takich jak Cursor czy Artifacts Claude’a.

Integracja z CustomGPTs

Dzięki Canvas personalizowani asystenci stają się jeszcze bardziej funkcjonalni. Wygoda użytkowania i nowe możliwości czynią z tej funkcji znaczące wsparcie zarówno dla twórców treści, jak i dla zespołów programistycznych.

Choć Canvas może wydawać się drobną zmianą, jego wpływ na komfort pracy z ChatGPT jest nieoceniony.

5/12 – Apple Intelligence (11.12.2024 r.)

Dzisiejsza premiera została poświęcona najnowszym aktualizacjom systemów Apple – iOS oraz MacOS. Tuż przed wypuszczeniem aktualizacji systemów firmy z Cupertino, Sam Altman z inżynierami zaprezentowali nowe możliwości integracji ChatGPT z Apple Intelligence. Wiele nowości z inteligentych funkcji w iOS i MacOS jest niedostępnych na terenie Unii Europejskiej, ale Apple już pracuje nad tym, by w przyszłym roku rozszerzyć dostęp na cały świat. Dziś jednak, polscy użytkownicy mogą przetestować wybrane funkcje, jeśli ustawili język angielski jako podstawowy język w ustawieniach systemu.

Jak wygląda integracja ChatGPT z Apple Intelligence?

W zakładce Apple Intelligence w Ustawieniach można zaznaczyć opcję „Wtyczka ChatGPT”, co umożliwi użytkownikom rozszerzenie funkcjonalności systemu o rozwiązania AI znane z chatbota. Oznacza to, że od teraz Siri wzbogaciła się o wiedzę i funkcje modeli OpenAI. Posiadacze iPhone’ów i Macbooków mogą prosić Siri nie tylko o operacyjne rzeczy, ale także o informacje – również te aktualne z internetu. Wszystkie treści generowane przy pomocy Siri są oczywiście dostępne także z poziomu aplikacji ChatGPT. A jeśli skorzystamy z funkcjonalności Canvas, to będziemy mogli także wprowadzać modyfikacje w wygenerowanych odpowiedziach.

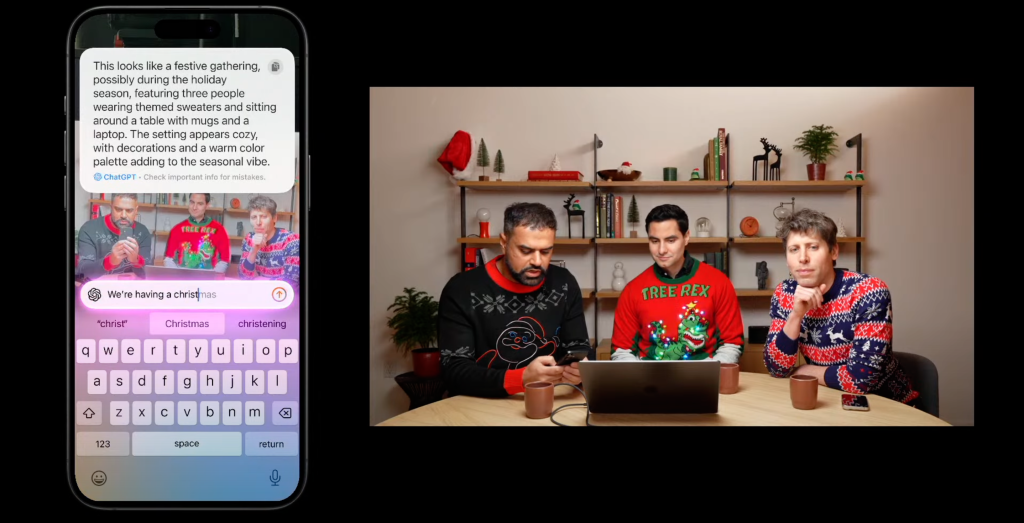

Drugą, największą w naszym odczuciu nowością, jest analiza wizji przez ChatGPT przy pomocy aparatu na iPhone’ach. Na bieżąco możemy wyświetlać w aparacie nasze otoczenie i pytać Siri o to, co widzi, jak interpretuje elementy, czy też bardziej przyziemne tematy jak rozwiązywanie zadań matematycznych naszych pociech.

Ostatnią zaprezentowaną dziś nowością jest częściowe analizowanie danych i plików wyświetlanych na ekranie. Możemy poprosić Siri/ChatGPT aby odpowiedź dotyczyła tylko wydzielonego tekstu / grafiki / wykresu widocznego na naszych wyświetlaczach.

6/12 – Analiza wideo w czasie rzeczywistym (12.12.2024 r.)

Dokładnie siedem miesięcy temu, na spotkaniu Spring Update, zaprezentowano po raz pierwszy możliwości zaawansowanego asystenta głosowego, który potrafił analizować wideo w czasie rzeczywistym. Przez ten czas inżynierowie z OpenAI szlifowali algorytmy, by dziś móc zaprezentować finalny efekt.

Nowa funkcjonalność ChatGPT umożliwia analizę obrazu, ruchu i dźwięku w czasie rzeczywistym. Model może na bieżąco interpretować wydarzenia widoczne na ekranie, odpowiadać na pytania dotyczące treści czy generować opisy oglądanych scen. Wszystko to odbywa się w czasie rzeczywistym, bez konieczności wcześniejszego przetwarzania plików wideo. Technologia ta jest oparta na zaawansowanych algorytmach uczenia maszynowego, które zostały zoptymalizowane przez inżynierów OpenAI, aby zapewnić dokładność i szybkość działania.

Jak skorzystać z nowej funkcjonalności?

Według zapowiedzi dzisiejszych prelegentów, zaawansowany asystent głosowy z możliwością analizy wideo jest już dostępny od dziś – większość subskrybentów planów Plus, Team i Pro powinna mieć włączoną opcję maksymalnie do końca przyszłego tygodnia. Z nowej funkcji cieszyć się mogą także użytkownicy planów Enterprise oraz Edu, ale nie wcześniej niż od stycznia przyszłego roku. Z kolei dostęp dla obywateli Unii Europejskiej oraz z krajów takich jak Szwajcaria, Islandia, Norwegia oraz Liechtenstein zostanie przyznany w bliżej nieokreślonym czasie – dokładnie tak samo jak w przypadku Sory.

Miły dodatek dla wszystkich użytkowników. Święty Mikołaj w ChatGPT!

Podczas dzisiejszego live streamu mogliśmy zobaczyć demo z użyciem zaawansowanego asystenta głosowego, który przemówił głosem… Świętego Mikołaja! Każdy użytkownik, który ma dostęp czasowy (plan Free) oraz dostęp stały w ramach płatnych planów, może porozmawiać z uroczym panem o świętach, tradycji, a także o takich sprawach, jak to gdzie mieszka i co robi przez resztę roku.

Aby uruchomić rozmowę z Świętym Mikołajem, wystarczy kliknąć w ikonkę płatka śniegu i zaakceptować nowy głos. Od razu będziemy mogli usłyszeć słynne ho, ho ho!

7/12 – Projekty: uporządkowana wiedza w ekosystemie ChatGPT (13.12.2024 r.)

Dzień siódmy przyniósł funkcję, którą OpenAI określa jako odpowiedź na potrzeby wielu użytkowników – Projekty. Choć nie jest to przełom technologiczny, a raczej udoskonalenie znane już z narzędzi konkurencyjnych, OpenAI nadało mu charakterystyczny „brokat” swojej technologii, co sprawia, że jest to wygodne i wszechstronne narzędzie w ramach ekosystemu ChatGPT.

Na czym polegają Projekty?

Projekty pozwalają użytkownikom tworzyć bazy wiedzy, do których można dodawać pliki, instrukcje i dokumentację. W odróżnieniu od podobnych rozwiązań, takich jak Claude od Anthropic, Projekty w ChatGPT oferują pełną integrację z istniejącymi funkcjami platformy, w tym Canvas i dostęp do sieci. Kluczowym elementem jest także możliwość porządkowania historii konwersacji w obrębie dedykowanych folderów – co znacząco usprawnia zarządzanie informacjami i współpracę zespołową.

Dla kogo?

Nowa funkcjonalność jest już dostępna dla subskrybentów planów Plus, Team i Pro. Niestety, użytkownicy planu Free muszą uzbroić się w cierpliwość – ich dostęp do Projektów przewidziano dopiero na początek przyszłego roku.

Projekty – mała zmiana, wielki wpływ

Choć Projekty mogą wydawać się niewielkim usprawnieniem, mają one potencjał, by stać się nieodzownym elementem codziennej pracy użytkowników ChatGPT. OpenAI konsekwentnie rozwija swoje narzędzia, dążąc do stworzenia kompleksowego ekosystemu, który nie tylko przyciąga, ale i zatrzymuje użytkowników na dłużej.

8/12 – SearchGPT: inteligentne wyszukiwanie i krok ku pełnemu ekosystemowi (16.12.2024 r.)

Ósmy dzień technologicznego maratonu OpenAI przyniósł coś, co dla wielu może okazać się jedną z najbardziej praktycznych aktualizacji – ulepszony SearchGPT. Choć funkcja wyszukiwania była dostępna w ograniczonej formie już wcześniej, dzisiejsze zmiany znacząco poszerzają jej możliwości i udostępniają ją wszystkim użytkownikom ChatGPT.

SearchGPT – co nowego?

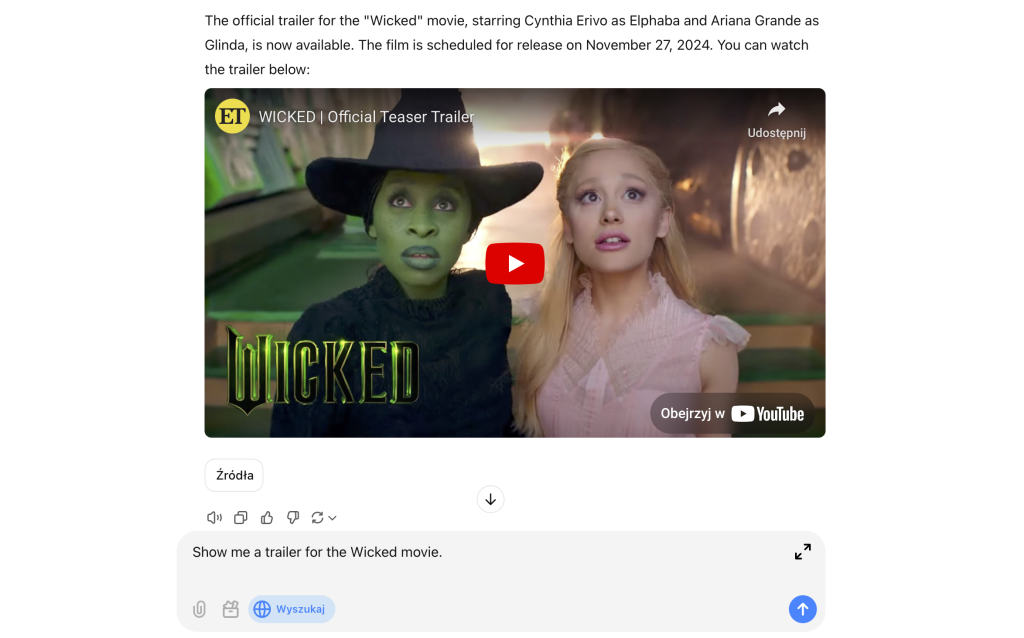

Ulepszony SearchGPT wyróżnia się przede wszystkim szybkością działania oraz lepszą integracją z urządzeniami mobilnymi. OpenAI postawiło na usprawnienie funkcjonalności w taki sposób, by użytkownik mógł uzyskać szybkie, precyzyjne odpowiedzi z sieci w czasie rzeczywistym, wraz z odnośnikami do źródeł. Od prognozy pogody, przez aktualne notowania giełdowe, po wyniki sportowe i bieżące wiadomości – to, co wcześniej wymagało żmudnego przeszukiwania stron, teraz trafia do nas w przystępnej, konwersacyjnej formie.

Co ważne, SearchGPT został zintegrowany z Advanced Voice Mode, co otwiera zupełnie nowe możliwości użytkowania. Podczas interakcji z ChatGPT możemy np. uruchomić film z YouTube’a w ramach jednej rozmowy czy odwołać się do informacji „widocznych” dla modelu w czasie rzeczywistym. To kolejny krok, który pokazuje, że OpenAI konsekwentnie dąży do stworzenia zamkniętego ekosystemu, w którym użytkownik nie musi już przeskakiwać między aplikacjami czy narzędziami. Wszystko, czego potrzebuje, może znaleźć w jednym miejscu – ChatGPT staje się tym samym czymś więcej niż chatbotem, a raczej interaktywną platformą roboczą.

Jak działa SearchGPT?

Dostępność dla wszystkich

Najlepsze wiadomości? SearchGPT jest już dostępny dla wszystkich zalogowanych użytkowników, niezależnie od planu subskrypcyjnego. To znacząca zmiana, która otwiera drzwi do nowych funkcji także dla osób korzystających z darmowej wersji ChatGPT.

Czy to przyszłość wyszukiwania, w której tradycyjne wyszukiwarki ustąpią miejsca AI? To pytanie, które wybrzmiewa coraz głośniej.

9/12 – Świąteczne upominki dla deweloperów w Playground

Dziś przedstawiciele OpenAI postanowili zaprezentować mini Dev-Day prezentując szeroką gamę nowych funkcji i narzędzi dla deweloperów, które mają na celu uproszczenie i przyspieszenie pracy z modelami AI oraz uczynienie ich bardziej dostępnymi.

Jedną z najważniejszych nowości jest pełna wersja modelu o-1 dla rozwiązań współpracujących z API. Model obsługuje teraz function calling oraz structured outputs, co ułatwia generowanie zorganizowanych i łatwych do przetwarzania wyników.

W ramach Playground, udostępniono również nowe narzędzia wspierające komunikację między API, a aplikacjami, możliwości wizualne, czyli przetwarzanie obrazów. Firma potwierdza również niższe opóźnienia.

Deweloperzy mogą również skorzystać z nowego parametru „reasoning effort”, który pozwala kontrolować poziom wysiłku wkładanego przez model w formułowanie odpowiedzi. Parametr ten pomoże zoptymalizować koszty i dostosować wydajność do potrzeb konkretnej aplikacji.

Usprawnienia Realtime API: wsparcie WebRTC

OpenAI zapowiedziało także wsparcie WebRTC w Realtime API, co znacząco ułatwia budowanie i skalowanie produktów wykorzystujących głos w czasie rzeczywistym. Dzięki tej integracji deweloperzy mogą tworzyć bardziej responsywne aplikacje działające na różnych platformach.

Dodatkowe aktualizacje Realtime API obejmują: 60% obniżkę kosztów tokenów audio, wsparcie dla GPT-4o mini oraz większą kontrolę nad odpowiedziami generowanymi przez API.

Fine-Tuning API: Preference Fine-Tuning

Dziś oglądaliśmy również funkcję Preference Fine-Tuning w API do dostrajania modeli. Pozwala ona na: optymalizację modeli w celu wzmocnienia preferowanych odpowiedzi oraz redukcję prawdopodobieństwa generowania niechcianych odpowiedzi.

Programiści korzystający z popularnych języków programowania doczekali się zapowiadanych nowości. OpenAI udostępniło SDK dla Go i Javy w wersji beta, co usprawni proces budowania aplikacji i integracji z modelami OpenAI w środowiskach enterprise i projektach o dużej skali.

10/12 – Infolinia ChatGPT

Najkrótsze, jak dotąd, wystąpienie w ramach świątecznego maratonu OpenAI. Pracownicy firmy przedstawili tym razem zupełnie niespodziewaną nowinę – infolinię ChatGPT.

OpenAI w swojej misji podkreśla, jak bardzo istotne jest to, aby każdy człowiek, niezależnie od statusu materialnego czy miejsca zamieszkania, miał dostęp do usług napędzanych sztuczną inteligencją. I dziś tę misję mocno wyeksponowali prezentując ChatGPT prosto z… linii telefonicznej. Dzięki tej innowacji, wystarczy zadzwonić pod dedykowany numer +1 (800) 242-8478 (tylko dla mieszkańców Stanów Zjednoczonych), aby uzyskać odpowiedzi na pytania, porady czy pomoc w codziennych zadaniach. Osoby spoza USA również mogą skorzystać z telefonicznego ChatGPT bezpośrednio w WhatsApp, dodając ten sam numer do kontaktów – choć rozmowy mogą być tylko w formie konwersacyjnej na chacie.

Według zapewnień przedstawicieli OpenAI, każdy dzwoniący może codziennie bezpłatnie skorzystać z 30 minut na rozmowę z ChatGPT dzwoniąc pod wyżej wskazany numer telefonu. Rozwiązanie to ma na celu zwiększenie dostępności technologii AI dla osób bez dostępu do nowoczesnych urządzeń, eliminując bariery cyfrowe i promując równość w dostępie do informacji.

11/12 – Jeszcze więcej możliwości ChatGPT w systemie MacOS

OpenAI wprowadziło nowe funkcje do aplikacji ChatGPT na macOS, zwiększając jej użyteczność i integrację z systemem. Dzięki zaawansowanemu trybowi głosowemu użytkownicy mogą teraz wydawać polecenia głosowe, co eliminuje konieczność pisania i umożliwia wykonywanie zadań bez przerywania pracy. Funkcja „Working with Apps” pozwala ChatGPT na bezpośrednią interakcję z innymi aplikacjami, zwłaszcza tymi do kodowania i notowania.

Przykładowo, w edytorze kodu, takim jak Warp, ChatGPT może analizować kod wyświetlany na ekranie, oferować sugestie, wyjaśnienia, a nawet generować nowe fragmenty kodu. Podobnie, w aplikacjach takich jak Apple Notes, Quip czy Notion, asystent AI może pomagać w tworzeniu notatek, planowaniu podróży czy rozbudowywaniu pomysłów, korzystając z informacji dostępnych w internecie. Aktualizacja jest już dostępna dla użytkowników Mac, a wersja dla systemu Windows ma pojawić się wkrótce.

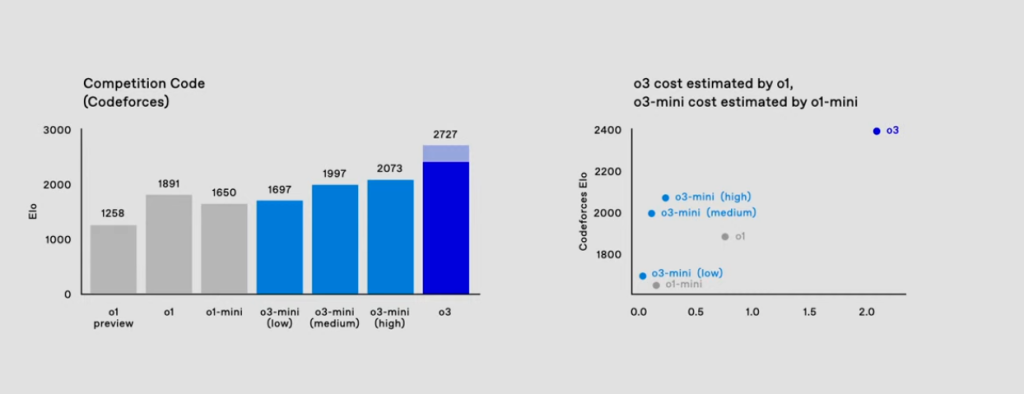

12/12 – nowy model o3

Sam Altman, CEO OpenAI, na swoim profilu w serwisie X zapowiedział dzisiejszą transmisję słowami „ho, ho ho, a raczej oh, oh oh”. Oczekiwania, zwłaszcza po debiucie Sory, były naprawdę wysokie. I teraz już wiem, że doczekaliśmy się nowych modeli o nazwie o3 i o3 mini.

Model o3 mini zostanie udostępniony do końca stycznia, a pełna wersja o3 pojawi się wkrótce potem. Te nowe modele mają przewyższać dotychczasowe możliwości AI, trenując je testach inteligencji Z kolei poprzednie modele o1, wprowadzone we wrześniu 2024 roku, wykazały zwiększone zdolności w rozwiązywaniu problemów z zakresu nauki, programowania i matematyki.

Obecnie modele o3 przechodzą wewnętrzne testy bezpieczeństwa, po których planowane jest otwarcie procesu aplikacyjnego dla zewnętrznych badaczy zainteresowanych testowaniem tych systemów przed ich publicznym udostępnieniem. Termin składania aplikacji mija 10 stycznia 2025 roku.

OpenAI kończy świąteczny maraton technologicznych nowości: nowe modele, funkcje i wizja AI przyszłości

I tym samym dzisiejsze spotkanie zakończyło świąteczny maraton technologicznych nowości. Przedstawiciele OpenAI przez ostatnie dni zaprezentowali szereg długo wyczekiwanych narzędzi, ulepszonych funkcji oraz zupełnie nowe podejście do współpracy ze sztuczną inteligencją.

Firma, mimo podkreślania swojej misji otwartej i szeroko dostępnej sztucznej inteligencji, pokazała również, że ChatGPT staje się coraz bardziej kompleksowym ekosystemem. Jego celem jest nie tylko ułatwienie pracy i rozwiązywania problemów, ale także utrzymanie użytkownika w obrębie platformy dzięki integracji kluczowych narzędzi i funkcji. Po zakończonym maratonie jedno jest jasne – OpenAI mocno stawia na rozwój i utrzymanie swojej pozycji lidera na rynku AI.