Twój koszyk jest obecnie pusty!

Amerykański konglomerat, do którego należą m.in. Facebook czy Instagram prace nad generatywną sztuczną inteligencją rozpoczął od serii modeli Make-A-Scene, które umożliwiły tworzenie obrazów, dźwięku, wideo i animacji 3D. Po pojawieniu się modeli dyfuzyjnych Meta zaczęła pracować z modelami Llama Image, które były w stanie generować obrazy i wideo w wyższej jakości, a także zapewnić edycję tych pierwszych. Movie Gen ma stanowić ich „trzecią falę” generatywnej sztucznej inteligencji, która łączy wszystkie wcześniejsze modalności, przewyższając tym samym modele konkurencji.

Co oferuje Meta Movie Gen?

Na ten moment nowo zaprezentowany przez firmę Marka Zuckerberga produkt wydaje się kompletnym narzędziem do produkcji materiałów wideo. Oprócz generowania wideo oferuje również personalizację, szczegółową edycję, a także tworzenie podkładu muzycznego i efektów dźwiękowych.

Meta w swoim wideo przedstawiła możliwości Movie Gen w czterech następujących obszarach:

- Przekształcanie tekstu w wideo – poprzez wprowadzenie polecenia tekstowego (promptu) Movie Gen umożliwia wygenerowanie 16-sekundowego filmu (przy 16 FPS/klatkach na sekundę) w jakości HD 1080p, który uwzględnia ruchy obiektów i kamery, a także interakcję między podmiotem a obiektem. Model transformatora składa się z 30 mld parametrów i wedle zapewnień Mety ma być najbardziej zaawansowanym generatorem wideo dostępnym na rynku.

- Tworzenie spersonalizowanego wideo – model na podstawie promptu i zdjęcia danej osoby może wygenerować film z jej wizerunkiem, zachowując przy tym płynny i naturalny ruch.

- Precyzyjna edycja wideo – zapewnia możliwość dodawania, usuwania lub zamiany obiektów, a także całościowe zmiany, takie jak modyfikacja tła czy stylu.

- Tworzenie dźwięku – Movie Gen umożliwia również stworzenie muzyki w tle, efektów dźwiękowych lub całej ścieżki dźwiękowej zsynchronizowanej z wideo. Model generowania dźwięku składa się z 13 mld parametrów i może wygenerować wysokiej jakości dźwięk (48 kHz) o długości do 45 sekund. Dodatkową opcją jest rozszerzanie dźwięku, które zapewnia możliwość stworzenia spójnego podkładu do filmów o dowolnej długości.

Jak Movie Gen wypada na tle konkurencji?

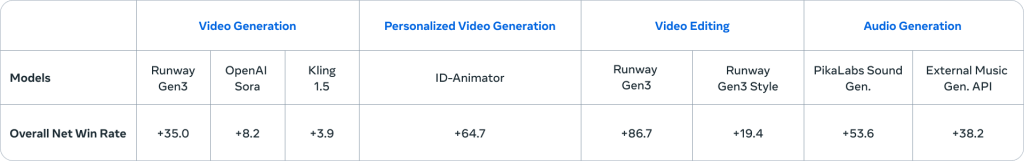

Meta zaprezentowała wyniki ocen w ramach przytoczonych wyżej czterech obszarów. Movie Gen zostało porównane z takimi modelami jak Runway Gen3, OpenAI Sora, Kling, ID-Animator czy PikaLabs Sound. „Overall Net Win Rate” pokazuje, jak dobrze Movie Gen wypada na tle konkurencyjnych modeli:

Źródło: https://ai.meta.com/blog/movie-gen-media-foundation-models-generative-ai-video/

Meta opublikowała również dokument badawczy, który m.in. pokazuje to, w jaki sposób uzyskali tak dobre wyniki w zakresie generowania: https://ai.meta.com/static-resource/movie-gen-research-paper

Kiedy będziemy mogli skorzystać z Movie Gen?

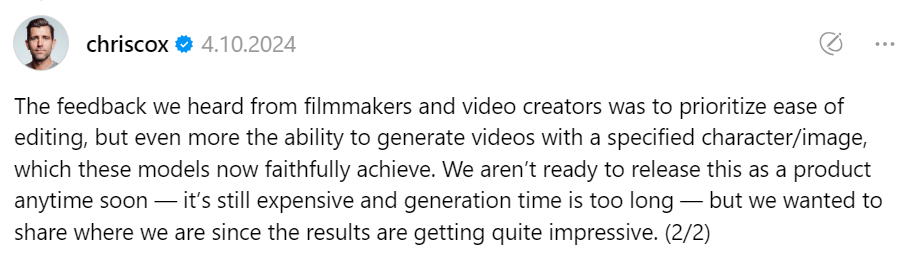

Na ten moment nie wiadomo jeszcze, kiedy narzędzie zostanie udostępnione do szerszego użytku. Na razie Meta zaprezentowała jedynie zwiastun wideo, który prezentuje możliwości modelu. Meta zapewnia, że szczególnie zależy im na dopracowaniu produktu, dlatego w trakcie udoskonalania swojego modelu będą współpracować z filmowcami i twórcami.

Chris Cox, dyrektor Mety ds. produktów napisał wprost na Threads, kiedy Movie Gen może wejść na rynek: „Nie jesteśmy gotowi, aby wypuścić to jako produkt w najbliższym czasie — nadal jest drogi, a czas generowania jest zbyt długi — ale chcieliśmy podzielić się tym, gdzie jesteśmy, ponieważ wyniki stają się całkiem imponujące”.

Natomiast Mark Zuckerberg opublikował na swoim Instagramie krótki film, na którym widać, jak robi trening nóg w zmieniających się sceneriach. Przy swoim wideo umieścił poniższy komentarz, sugerując, że możemy spodziewać się Movie Gen już w przyszłym roku.

Jednak premiera Movie Gen może dodatkowo odłożyć się w czasie, ponieważ Meta mocno pracuje nad dodaniem do swojego narzędzia konkretnych zabezpieczeń. Udostępni go dopiero wtedy, kiedy uzna, że jest w pełni bezpieczne. Co ciekawe już teraz Meta zapewnia, że: „Wyszkoliliśmy te modele na kombinacji licencjonowanych i publicznie dostępnych zestawów danych”. Jest to bardzo ważna kwestia, ponieważ jeśli Meta faktycznie chce zrewolucjonizować branżę kreatywną i filmową to takie aspekty jak prawa autorskie czy transparentność danych wykorzystanych do trenowania modeli są absolutnie kluczowe.

Jak narzędzia GenAI wpływają na branżę filmową?

Od momentu pojawienia się modeli AI do generowania wideo, narasta wokół nich spora ciekawość, ale także wiele zapytań o przyszłość branży czy etyczność używania takich narzędzi. Aktualnie firmy uwzględniają klauzulę dotyczącą wykorzystywania AI/ML, która wymaga pozwolenia na użycie jakiejkolwiek generatywnej sztucznej inteligencji w produkcjach, a także gwarantuje, że wszystkie materiały oraz dane użyte do szkolenia modeli GenAI są licencjonowane.

Niedawno firma Lionsgate, znana m.in. z produkcji „Igrzysk Śmierci” czy „American Psycho” nawiązała współpracę z Runway. Wszystko po to, by umożliwić wytrenowanie nowego modelu AI na podstawie ich archiwum (ponad 20 000 tytułów) filmów i programów telewizyjnych. I chociaż ta decyzja wzbudziła wiele kontrowersji w środowisku filmowym, to ludzie w Lionsgate są przekonani, że postępują słusznie. Zakładają, że dzięki sztucznej inteligencji będą w stanie zaoszczędzić miliony dolarów.

Sprawni twórcy, nie zważając na sceptyczne głosy, już teraz potrafią wykrzesać z narzędzi GenAI bardzo dużo dobrego. Przykładem jest ekipa shy kids, która jakiś czas temu przy pomocy narzędzia Sora od OpenAI stworzyła krótki film o człowieku z balonem zamiast głowy.

Spotkał się on z bardzo ciepłym odbiorem i jak dotąd jest jednym z lepszych przykładów wykorzystania narzędzia GenAI do stworzenia wartościowego dzieła audiowizualnego.

Zupełnie innym przykładem wykorzystania GenAI jest opublikowany ostatnio trailer słynnego anime „Księżniczka Mononoke”, który został stworzony przy pomocy Kling, czyli chińskiego narzędzia do generowania wideo.

Na tę produkcję wylała się lawina negatywnych opinii, szczególnie ze strony fanów studia Ghibli i uwielbianego filmu animowanego autorstwa jednego z najlepszych animatorów – Hayao Miyazaki. Zresztą sam Miyazaki już w 2016 roku bardzo negatywnie wypowiadał się na temat wykorzystywania AI do produkcji: „…nigdy nie chciałbym włączać tej technologii do swojej pracy. Jestem głęboko przekonany, że to obraza samego życia”.

Autor zwiastuna live-action, PJ Acetturo początkowo usunął go ze swojego profilu na platformie X ze względu na bardzo dużą skalę negatywnych komentarzy, ale po krótkim czasie postanowił go przywrócić, opatrując komentarzem: „Po 22 milionach wyświetleń i tysiącach gróźb śmierci poczułem, że muszę usunąć ten post dla własnego zdrowia psychicznego. Ten zwiastun był EKSPERYMENTEM, który miał pokazać moim 300 znajomym z X, jak daleko zaszliśmy w ciągu 16 miesięcy. Zamieszczam to ponownie, aby podtrzymać dyskusję”.

Powyższy przykład dobitnie pokazuje, że sztuczna inteligencja nadal budzi wiele kontrowersji i wątpliwości, szczególnie w kontekście wykorzystywania jej w branży artystycznej. Dlatego warto pamiętać, że każdy model GenAI, nawet tak kompletny, jak ten zapowiadany przez Metę, to nadal wyłącznie produkt, który ma pełnić funkcję wsparcia i pobudzać kreatywność. Bez sprawnego operatora żadne narzędzie nie jest w stanie zrobić czegoś, co mogłoby konkurować z dzisiejszymi produkcjami filmowymi. Nie powinniśmy traktować Movie Gen czy innych modeli GenAI jako zagrożenia dla filmowców i twórców, a bardziej jako szansę na usprawnienie procesów produkcyjnych. Dzięki tej technologii wiele osób będzie mogło wyrazić się artystycznie bez ogromnych nakładów finansowych, często niezbędnych do realizacji danego projektu.

Miejmy nadzieję, że Meta Movie Gen nie podzieli losu Sory, którą OpenAI zaprezentował na początku tego roku jako niesamowite narzędzie GenAI, a która nadal nie została udostępniona do ogólnego użytku.