Twój koszyk jest obecnie pusty!

Inez Okulska: Czym właściwie są Wojska Obrony Cyberprzestrzeni? Czym się zajmują? Mam przeczucie, że wpisana w nazwę definicja wcale nie wyczerpuje tematu.

Gen. Karol Molenda: Wojska Obrony Cyberprzestrzeni są zdefiniowane ustawowo jako specjalistyczny komponent sił zbrojnych uprawniony do prowadzenia operacji w cyberprzestrzeni w pełnym spektrum, co oznacza, że zajmujemy się aktywną obroną, nie tylko w systemach wojskowych, ale również w systemach kluczowych z punktu widzenia sił zbrojnych.

I tu mam na myśli systemy służące do wymiany informacji i prowadzenia operacji wojskowych, a także systemy, bez których prowadzenie operacji wojskowych nie mogłoby być efektywne – jak infrastruktura krytyczna związana z przepływem paliw, logistyką czy transportem. Nasza formacja jest stosunkowo młoda, powstała w odpowiedzi na deklarację złożoną w trakcie szczytu NATO w Warszawie w 2016 r., gdzie zdefiniowano cyberprzestrzeń jako piątą domenę operacyjną – obok lądu, wody, powietrza i kosmosu.

IO: To prawie jak piąty żywioł!

GKM: Można tak powiedzieć. Ale ciekawe jest to, że właśnie jako jedyny został stworzony tylko przez człowieka i przez człowieka jest modyfikowany. A my zło- żyliśmy deklarację (Cyber Defense Pledge), że będziemy posiadać kompetencje do obrony tej domeny operacyjnej, więc trzeba było sformować dedykowaną do tego zadania strukturę. Ale – jak słusznie podejrzewałaś – Wojska Obrony Cyberprzestrzeni to nie tylko „cyber”.

IO: I nie tylko obrona?

GKM: Działamy w trzech głównych obszarach. Pierwszy to kryptologia, w tym kryptografia i kryptoanaliza – tworzymy i łamiemy szyfry, starając się kultywować tradycje naszych kryptologów: Rejewskiego, Zygalskie- go i Różyckiego. Budujemy algorytmy kryptograficzne zgodne z zasadą quantum safe (kryptografia postkwantowa), zajmujemy się generacją dokumentów kryptograficznych i tworzeniem urządzeń szyfrujących.

Drugi filar to informatyka – budujemy i utrzymujemy główne systemy i sieci teleinformatyczne dla całych sił zbrojnych. Mamy w swojej pieczy jawny system teleinformatyczny, obejmujący ponad 150 tys. użytkowników, ale poza nim są jeszcze: systemy niejawne, system Polish Mission Network na poziomie NATO Secret i inne systemy wysokiej klauzuli. W zasadzie nie ma komputera, smartfonu, tabletu czy innego urządzenia, które nie zostałoby przez nas zakupione, skonfigurowane, monitorowane i utrzymywane – dbamy o cały cykl życia systemu, włącznie z wycofaniem starych elementów i ich niszczeniem.

Trzecim filarem jest cyberbezpieczeństwo, w tym m.in. CSIRT MON (Computer Security Incident Response Team) jako CSIRT poziomu krajowego, który zgodnie z ustawą o krajowym systemie cyberbezpieczeństwa zajmuje się koordynacją i obsługą incydentów w obszarze odpowiedzialności MON. Działamy bez przerwy, w trybie 24/7. Nasi żołnierze i pracownicy pracują na salach operacyjnych, stale monitorując bezpieczeństwo systemów.

IO: Czy fakt, że atakujący wykorzystują sztuczną inteligencję sprawia, że te ataki są bardziej dotkliwe, trudniejsze do odparcia?

GKM: Najczęściej spotykane są ataki łączące operacje w cyberprzestrzeni z operacjami informacyjnymi, wykorzystujące socjotechniki. Atakujący, nie mogąc pokonać wielu warstw zabezpieczeń technicznych, próbuje oddziaływać na użytkownika, licząc, że ten zrobi coś niewłaściwego. Jednak większość naszych narzędzi wyłapuje takie działania na początku łańcucha ataku (kill chain), minimalizując możliwości popełnienia błędu przez użytkownika.

Mamy świadomość wykorzystania deepfejków i modeli generatywnych AI do bardziej wiarygodnych ataków, ale na przestrzeni lat sięgano już po wiele wyrafinowanych narzędzi, to po prostu kolejne z nich. Jesteśmy czujni, ale nie przerażeni – nie uważam, żeby był to jakiś wielki game changer, który drastycznie zwiększył liczbę incydentów. Cyberbezpieczeństwo to nieustający pro- ces, ale na chwilę obecną czujemy się komfortowo dzięki doświadczeniu zespołu po licznych próbach ataków.

IO: Skoro obrona przed AI ze strony przeciwnika jest zaopiekowana, to co z wykorzystywaniem jej po Waszej stronie?

GKM: No właśnie, do tych trzech bardziej tradycyjnych filarów dochodzi teraz budowanie innowacyjnych rozwiązań w zakresie najnowszych technologii. Nie bez powodu mówi się, że wiele przełomowych technologii, nawet tych, które potem zostały skomercjalizowane na rynku cywilnym, pierwotnie powstało na potrzeby militarne. Nawet jak pomyślimy o Internecie – on też został wymyślony dla armii, a potem wywrócił do góry nogami cały świat, nie tylko wojskowy. Więc staramy się inicjować i wykorzystywać technologie podwójnego zastosowania (dual use technologies) i technologie przełomowe (emerging and disruptive technologies).

Z tą myślą zostało powołane Centrum Implementacji Sztucznej Inteligencji (CISI). To nasza wewnętrzna komórka organizacyjna, która ma za zadanie implementować rozwiązania z zakresu sztucznej inteligencji na potrzeby sił zbrojnych i nie tylko. To zresztą jest wpisane w naszą strategię – bo warto dodać, że jako jedyny resort opracowaliśmy strategię sztucznej inteligencji sięgającą roku 2039.

IO: Wow, 2039? W biznesie nie mogą się zgodzić, jak będzie wyglądał rynek AI za 5 lat, a Wy macie wizję na półtorej dekady wprzód!

GKM: Sięgamy daleko za horyzont [uśmiech]. Ale to normalna praktyka, armia planuje budowanie zdolności na 15 lat do przodu. Teoretycznie tak to się definiuje i tak przypisuje się budżety. W naszej strategii zdefiniowaliśmy kilka obszarów, w których chcemy zaimplementować sztuczną inteligencję w systemach i rozwiązaniach wojskowych.

IO: Jak w takim razie planujecie wdrażać AI do walki z rzeczonym piątym żywiołem?

GKM: Mechanizmy sztucznej inteligencji nie pojawiły się dwa lata temu, wraz z upublicznieniem modeli generatywnych – to narzędzia, które były już wcześniej wykorzystywane w różnych aspektach, również przez nas w zakresie cyberbezpieczeństwa.

Nasze systemy wojskowe są łakomym kąskiem dla tzw. grup APT (Advanced Persistent Threats) powiązanych z różnymi służbami specjalnymi nieprzyjaznych nam krajów, w tym Rosji. Te grupy różnią się od zwykłych grup cyberprzestępczych tym, że nie szukają szybkich zysków finansowych. Otrzymują konkretne zadania i finansowanie od służb lub wojska, mają za zadanie wejść do określonego systemu i wyprowadzić stamtąd informacje. Nie poddają się, gdy napotykają trudności – próbują dzień po dniu, kropla po kropli drążą skałę.

Niektóre grupy APT mogą też prowadzić tzw. operacyjne przygotowanie środowiska do działania. Mogą pojawić się w infrastrukturze wojskowej lub krytycznej, nie uzyskując natychmiastowych efektów, ale być gotowe np. odciąć prąd, wywołać blackout, zatrzymać przepływ paliw czy logistykę w korzystnym dla nich momencie. I to są realne zagrożenia. Naszym zadaniem jest być o krok przed nimi, zawsze.

Zarządzając tak ogromną infrastrukturą, musimy być w stanie znaleźć wzorzec pośród szumu. Gdy mamy systemy z ponad 150 tys. użytkowników, kluczowe jest wychwycenie wszelkich, nawet najdrobniejszych, sugestii świadczących o możliwej obecności przeciwnika. I właśnie rozwiązania bazujące na sztucznej inteligencji są idealne do wyszukiwania anomalii, wykrywania nie- typowych procesów i identyfikowania potencjalnych zagrożeń.

IO: Ale anomalii przez Was zdefiniowanych, w systemie półinteligentnym, automatyzującym wiedzę człowieka, czy bardziej autonomicznym, który znajduje to, o czym nawet nie wiedzieliście, że szukacie. Czy w Waszej pracy ten mocny skok technologii jest odczuwalny?

GKM: Na pewno pojawia się zdecydowanie mniej fałszywych alarmów, które pojawiały się w starszych urządzeniach. W cyberbezpieczeństwie mamy już narzędzia state-of-the-art z wbudowanymi automatycznymi mechanizmami AI, i to rzeczywiście pomaga naszym operatorom, ale właśnie w takim wydaniu współpracy człowieka i sztucznej inteligencji. Wiele naszych systemów ze względów bezpieczeństwa jest odseparowanych od Internetu (tzw. air gaps). Jeśli operator ma dostęp do dużej ilości danych o anomaliach, może wykorzystać tę wiedzę i odpytywać modele, które zostały wytrenowane w sieci jawnej, a następnie stosować tę wiedzę w sieci niejawnej. To przyśpiesza pracę operatorów i zwiększa ich efektywność.

IO: A czy jakiekolwiek elementy procesów są całkowicie oparte na AI, gdzie np. filtracja czy monitoring od- bywają się zupełnie bez udziału człowieka?

GKM: Na pierwszym poziomie w CSIRT MON, przy tak rozległych sieciach, bazujemy zarówno na rozwiązaniach komercyjnych, jak i opracowanych przez nas, żeby oddzielać ziarno od plew – prawdziwe zagrożenia od fałszywych alarmów. To są gigantyczne ilości danych, bez tej automatyzacji potrzebowalibyśmy ogromnej liczby operatorów, a ich percepcja przy dużej ilości ataków i tak byłaby ograniczona. Na przykład ze względu na fakt, że przez polskie centrum logistyczne w Rzeszowie, przez które przechodzi prawie cała pomoc dla Ukrainy, byliśmy i jesteśmy pod ogromnym ostrzałem grup APT. Tylko w pierwszym roku pełnoskalowej wojny w Ukrainie od- notowaliśmy ponad pięciokrotnie więcej ataków na naszą infrastrukturę niż rok wcześniej. Mając tak złożoną sieć, ogromną liczbę urządzeń końcowych i użytkowników oraz pięciokrotnie większą liczbę ataków, bez automatyzacji wielu procesów przeciwnik miałby przewagę. A naszą aspiracją jest być o krok lub nawet dwa przed przeciwnikiem.

IO: I to nie tylko w obszarze cyberbezpieczeństwa.

GKM: Dokładnie! We wspomnianej strategii wskazaliśmy konkretne obszary, w których będziemy – po części już to robimy – implementować systemy sztucznej inteligencji. Oprócz wsparcia obrony przed cyberatakami, szybszej identyfikacji, neutralizacji zagrożeń czy wykrywania podatności w zasobach własnych, jest szereg zastosowań, w tym zastosowania dotyczące fizycznych urządzeń czy skierowanych na człowieka i wsparcie jego efektywności.

- Optymalizacja logistyki – mówi się, że wojsko zaczyna operację, a logistyka ją wygrywa. Albo przegrywa, przez jej brak. I to rzeczywiście ogromny, absolutnie kluczowy element obejmujący zapewnienie posiłków żołnierzom, amunicji, sprzętu, prac serwisowych, za- opatrzenia i transportu. Nowoczesne platformy same raportują potrzeby (np. kończąca się amunicja, konieczność naprawy), a te informacje muszą być odpowiednio zarządzane. I tutaj rozwiązania, które połączą te dane i zoptymalizują procesy.

- Autonomiczne systemy bojowe – większe wsparcie realizacji zadań przez platformy bezzałogowe, zmniejszenie zaangażowania człowieka w zadania wysokie- go ryzyka, rozwój rojów dronów. Z doświadczeń wojny w Ukrainie wiemy, że przeciwdziałanie dronom odbywa się poprzez zakłócanie (walkę radioelektroniczną). Dzięki AI drony mogą teraz oznaczać cele i eliminować je nawet w warunkach silnych zakłóceń. Roje dronów z zaimplementowaną AI mogą komunikować się ze sobą nawzajem i podejmować samodzielne decyzje, precyzyjniej realizować swoje zadania.

- Analiza informacji rozpoznawczo-wywiadowczych, czyli przetwarzanie dużej ilości danych z różnych źródeł i sensorów. W wojsku rozróżnia się sensory (urządzenia zbierające informacje) i efektory (urządzenia uzyskujące efekty). Na przykład samolot F-35 jest zarówno potężnym efektorem, jak i latającym sensorem, który realizuje zadania rozpoznawania terenu lub teatru działań. AI pomaga zidentyfikować wzorce, anomalie i trendy w zachowaniach przeciwnika – namierzać go, ale także przewidywać jego intencje.

- Wsparcie dowódców w podejmowaniu decyzji – analiza różnych scenariuszy działania, sugerowanie optymalnych rozwiązań, przewidywanie rekomendacji i szybsze wypracowanie decyzji. Tradycyjnie dowódca wojskowy podejmuje decyzje na podstawie analiz przy- gotowanych przez swój sztab. AI może wspierać ten proces, wyciągając wnioski z ogromnej ilości danych, których sztab nie byłby w stanie przeanalizować w tym samym czasie.

- Wsparcie symulacji i szkolenia – tworzenie materiałów szkoleniowych, realistyczne symulacje warunków bojowych, wykorzystanie wirtualnych środowisk treningowych, tworzenie spersonalizowanych ścieżek rozwoju. Przy armii zmierzającej do 300 tys. żołnierzy potrzeby szkoleniowe są ogromne, a AI może pomóc w prowadzeniu symulacji i gier wojennych do testowania różnych strategii i taktyk.

IO: Czyli dobrze zorganizowany Excel to za mało?

GKM: Totalnie! Chyba tak wielozakładkowego arkusza żaden Excel by nie udźwignął. My mamy swoje własne systemy, jak ZWSI RON, gdzie mamy wszelkie dane na temat logistyki i sprzętu. Mamy też własny system Battlefield Management System (BMS). I jesteśmy chyba jedyną armią w NATO, która rzeczywiście zbudowała własny system, a nie skorzystała z rozwiązania komercyjnego. I teraz w ramach działania Centrum Implementacji Sztucznej Inteligencji chcemy zbudować kolejny moduł, który połączy oba systemy i zaproponuje wielokryterialną optymalizację.

IO: Dlaczego zdecydowaliście się zbudować własny system, skoro jest to bardzo rzadka praktyka?

GKM: Po pierwsze – bo mogliśmy [śmiech]. I mam tu na myśli zasoby intelektualne naszej jednostki. DK WOC jest wyjątkowym miejscem, też niespotykanym w NATO. Na sześć i pół tysiąca inżynierów i ekspertów od łączności, informatyki, krypto- i cyber-, tysiąc z nich to programiści. Mamy więc praktycznie własny software house. W administracji publicznej, szczególnie w domenie wojskowości, nie ma drugiego takiego.

Ale to też nie jest tak, że specjaliści się nudzili, więc trze- ba było wymyślić projekt – zawsze uważałem, że tego typu systemy zarządzania jak BMS mogą być „miękkim podbrzuszem”, bo gromadzą w sobie ogromne ilości wrażliwych, najwyższej wagi informacji taktycznych. Gdybym był przeciwnikiem, swoje wysiłki kierowałbym właśnie na to, by się do takiego systemu dostać. Inne kraje natowskie używają wspólnego komercyjnego rozwiązania, co jest świetne ze względu na kompatybilność, ale w przypadku ataku na taki system możemy mieć w garści od razu kilka tych krajów naraz. A z doświadczenia wiem, że jeśli rozwiązanie jest komercyjne, czyli jawne, dostępne na rynku, to może być przez przeciwnika szczegółowo analizowane pod kątem podatności, możliwości złamania zabezpieczeń. Nasze rozwiązanie jest nie tylko niedostępne publicznie, ale też – zgodnie ze sztuką programistyczną i zasadami bezpieczeństwa kontrwywiadowczego – zostało zbudowane w sposób tak rozproszony, że w całych naszych szeregach nie ma ani jednej osoby, która zna całość tego systemu.

IO: Czyli konkretne zespoły były odpowiedzialne za swój puzzel, z którego gdzieś na końcu powstaje spójny obraz?

GKM: Tak, taka była filozofia, nawet nas gdzieś za ten system pochwalono [uśmiech]. I mimo że jest nasz, to jest też interoperacyjny, działa na wspólnych proto- kołach, komunikuje się z tymi komercyjnymi BMS-ami, które są używane w NATO – w przypadku wspólnej operacji jesteśmy pełnoprawnym partnerem.

IO: To bardzo krzepiąca wiadomość! Choć, jak sam wskazałeś, jest jeszcze wiele innych obszarów, w których dopiero zaczynacie wdrażanie technologii. Co jest największą przeszkodą we wprowadzaniu sztucznej inteligencji w sektorze wojskowym? Sama techno- logia, przepisy prawne czy kultura organizacyjna?

GKM: Mówi się, że kultura zjada strategię na śniadanie – i to prawda. I odpowiednie podejście do kultury organizacyjnej ma ogromne znaczenie. W Wojskach Obrony Cyberprzestrzeni zbudowaliśmy ją zupełnie inaczej, niż funkcjonowała przez lata w siłach zbrojnych. Kluczowe jest właściwe przedstawienie nowości – jak w sporcie, gdzie to podający odpowiada za dobre podanie pił- ki. Żeby druga strona mogła ją przyjąć, musi wiedzieć, skąd i po co leci. To właśnie nasze zadanie – przekonać dowódców do wykorzystywania dostępnych technologii, sprawić, że poczują ich potencjał, pokazać ich realną wartość i korzyści. Czasami rzeczy oczywiste dla inżynierów nie są tak oczywiste dla osób mniej technicznych.

IO: A co z rewolucją ostatnich lat, czyli generatywną sztuczną inteligencją, wielkimi modelami o wielkich możliwościach, ale też wielkich ograniczeniach. Rozważacie jej wykorzystanie? Możliwość halucynacji, niepewność co do mechanizmów działania dużych modeli raczej nie kojarzy się z sektorem wojskowym.

GKM: Generalnie w krytycznych zastosowaniach nie możemy sobie pozwolić – i to nie tylko z powodów etycznych – na implementację rozwiązania, które daje 70% prawdopodobieństwa, np. trafienia w cel, ponieważ te brakujące 30% jest po prostu nieakceptowalne. Dopiero gdy mamy technologię, która umożliwia osiągnięcie niezbędnej skuteczności, nawet w trudnych warunkach, otwiera się ogromna przestrzeń do jej wdrożenia.

Natomiast są obszary obciążone mniejszym ryzykiem – jak wspomaganie szkoleń, gdzie generatywna sztuczna inteligencja, mimo swoich ograniczeń, może się bardzo przydać, bo daje niesamowite pole do tworzenia niezliczonych wariantów scenariuszy interakcji, zaawansowanych gier taktycznych. Zresztą nie tylko w aspekcie szkolenia – samo testowanie różnych taktyk „na sucho” może być ogromnym wsparciem dla dowódców. I nie chodzi tu o poleganie na podpowiedziach z modelu, tylko o możliwość prześledzenia symulowanych wariantów, które człowiek będzie mógł przeanalizować i z tą wiedzą podejmować decyzje.

IO: Czyli bardziej wewnętrznie jako wsparcie w szkoleniach i symulacjach, a nie operacyjnie?

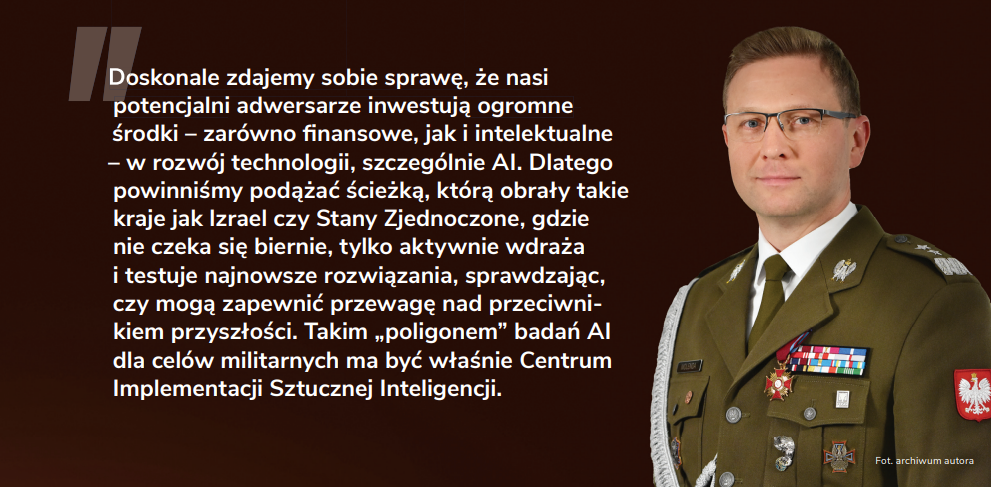

GKM: Powiem tak: mam przywilej pracować z wyjątkową grupą ludzi o otwartych umysłach. Od 2019 r., gdy budowałem ten zespół, stawiałem na otwartość i burze mózgów, które regularnie organizujemy. I z taką otwartą głową podchodzimy do nowości. To, że pewne technologie na dziś są mniej dojrzałe, nie oznacza, że powinniśmy się na nie całkowicie zamykać. Nie możemy ich ignorować. Chcę, by moi inżynierowie – a w naszym zespole mamy wyjątkowo duże „stężenie” doktorów i ekspertów na metr kwadratowy – analizowali możliwe scenariusze wykorzystania nowych rozwiązań i testowali je w praktyce. Tylko w ten sposób możemy być o krok przed przeciwnikiem. Bo doskonale zdajemy sobie sprawę, że nasi potencjalni adwersarze inwestują ogromne środki – zarówno finansowe, jak i intelektualne – w rozwój podobnych technologii. Dlatego powinniśmy podążać ścieżką, którą obrały takie kraje jak Izrael czy Stany Zjednoczone, gdzie nie czeka się biernie, tylko aktywnie wdraża i testuje nowe technologie, sprawdzając, czy mogą zapewnić przewagę nad przeciwnikiem przyszłości. I tutaj takim „poligonem” badań ma być właśnie centrum CISI.

IO: No właśnie, wróćmy jeszcze na chwilę do styku nauki, biznesu i wojska, czyli CISI.

GKM: W wielu instytutach badawczych rozwijane są ciekawe rozwiązania, ale finalnie podzielają los tzw. „półkowników”, czyli projektów odkładanych na półkę, nigdy niewdrożonych, bo nie doczekały się aktywne- go odbiorcy. Jeśli odbiorca uczestniczy w projekcie na każdym etapie i zależy mu na implementacji, to projekt rozwija się zupełnie inaczej. A dodatkowo DKWOC to nie tylko cyberbezpieczeństwo, ale także organizator wszystkich systemów i sieci. Wszystkie zasoby i bazy danych ze wszystkich systemów sił zbrojnych mają swoje serce tutaj, nikogo nie musimy prosić o dane – to tylko kwestia organizacji tych danych we właściwy sposób. „Paliwo” do sztucznej inteligencji mamy u siebie, więc jest to solidna podstawa do współpracy z zespołami badawczymi. Naszą wizją jest stworzenie ekosystemu, w którym myśl technologiczna jest generowana w najlepszych instytutach czy jednostkach badawczych w tym kraju – w tym np. w instytucie IDEAS – a my te rozwiązania implementujemy w systemach wojskowych, czasem wspierając je już na etapie rozwoju. Nie chcemy tworzyć kolejnej jednostki stricte badawczej, ale właśnie wykorzystywać dostępne, wypracowane przez inne pod- mioty rozwiązania. Nasi eksperci mają za zadanie znaleźć sposób na ich dostosowanie i praktyczne wdrożenie.

IO: To naprawdę budujące, bo rzeczywiście wiele zespołów badawczych mogłoby rozwijać konkretne systemy usprawniające procesy wojskowe, ale dopóki nie zostaną zamówione – a to z formalnego punk- tu widzenia łatwiej powiedzieć, niż zrobić – pozostają w zawieszeniu, gdzieś pomiędzy wyobrażeniem badacza a rzeczywistymi potrzebami czy danymi z sektora militarnego.

GKM: No właśnie ta „ostatnia mila” jest kluczowa i wy- maga odpowiednio skonstruowanego pomostu pomiędzy instytucjami cywilnymi a naszymi jednostkami. W wielu systemach wojskowych dostęp jest ograniczony na przykład do osób z odpowiednim poświadczeniem bezpieczeństwa lub posiadających polskie obywatelstwo, a to wcale nie znaczy, że osoby niespełniające tych wymagań nie są świetnymi twórcami technologii, że nie mogą jej dostarczać.

IO: No i dzięki temu jest większa szansa na korzystanie z rozwiązań powstających w Polsce.

GKM: Dokładnie tak! Jestem w pełni przekonany, że Polacy mają ogromny potencjał intelektualny i stać nas na naprawdę wielkie rzeczy – oczywiście przy odpowiednim wsparciu. I mam nadzieję, że doczekam chwili, w której będziemy mogli powiedzieć, że korzystamy z rozwiązań opartych na polskich pomysłach i polskiej myśli technologicznej. Mój zespół również ma to na uwadze i jeśli tylko pojawi się taka możliwość, będzie chciał z niej skorzystać – na przykład będzie na pewno testował nasze polskie duże modele językowe.