Twój koszyk jest obecnie pusty!

DeepSeek to chińska firma, która niedawno opublikowała serię modeli językowych w wersji open-source, w tym model DeepSeek-V3 oraz dwie wersje modelu ukierunkowanego na rozumowanie: DeepSeek-R1-Zero (trenowany wyłącznie poprzez uczenie ze wzmocnieniem) oraz DeepSeek-R1 (który wykorzystuje wieloetapowe podejście do treningu). I choć codziennie gdzieś na świecie publikuje się nowe modele, to właśnie ten konkretny zestaw na chwilę dosłownie wstrząsnął światem technologii i biznesu i to tak, że zawrzało na giełdzie. Dlaczego?

Transformer z… twistem?

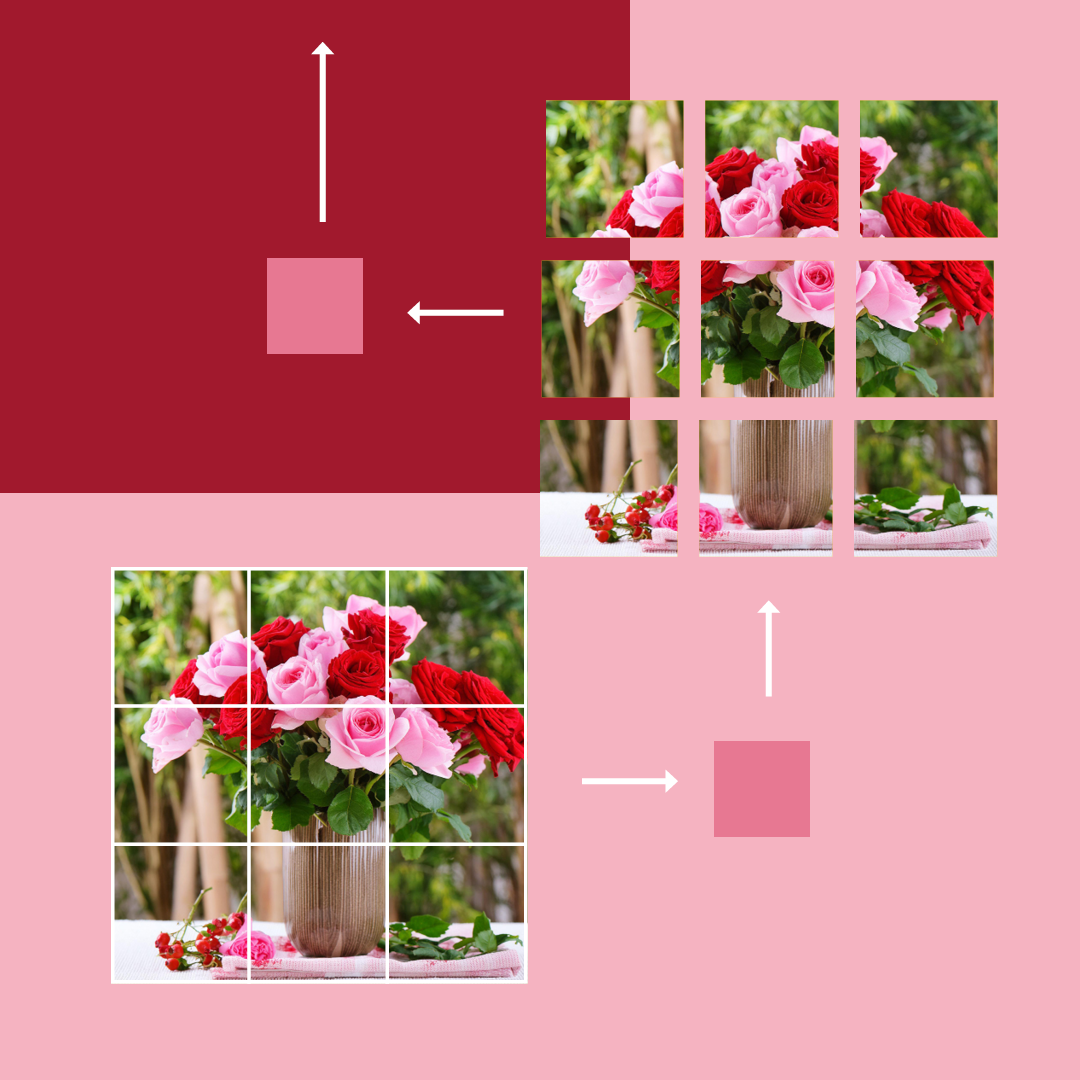

Architektura DeepSeek bazuje na klasycznej architekturze typu transformer (omówionej szczegółowo w „hAI Magazine” nr 1/2024), z tą kluczową różnicą, że standardowe warstwy feed-forward zostały zastąpione warstwami MoE (Mixture of Experts). W warstwach MoE zamiast jednej sieci feed-forward, mamy zestaw ekspertów (również sieci feed-forward) oraz zaawansowany system ich wyboru, który decyduje, którzy eksperci będą przetwarzać dany token. Takie podejście pozwala modelowi osiągać wyniki porównywalne z wiodącymi modelami zamkniętymi, przy równoczesnym zachowaniu efektywności obliczeniowej.