Twój koszyk jest obecnie pusty!

Wyobraź sobie, że żyjesz w przyszłości, gdy technologia jeszcze bar- dziej się rozwinęła, a podróże kosmiczne nie są już marzeniem, lecz czymś na porządku dziennym. Na każdym statku – poza kapitanem i pilotami – są naukowcy, mechanicy i specjaliści od systemów pokładowych. Ktoś musi w końcu pilnować, żeby wszystko działało po- prawnie: potężne silniki, narzędzia wytwarzające atmosferę, a także powszechnie używana sztuczna inteligencja, która pomaga wyznaczyć poprawną trajektorię lotu statku, napisać e-mail czy rozpoznać język, którym posługują się nowo poznani kosmici.

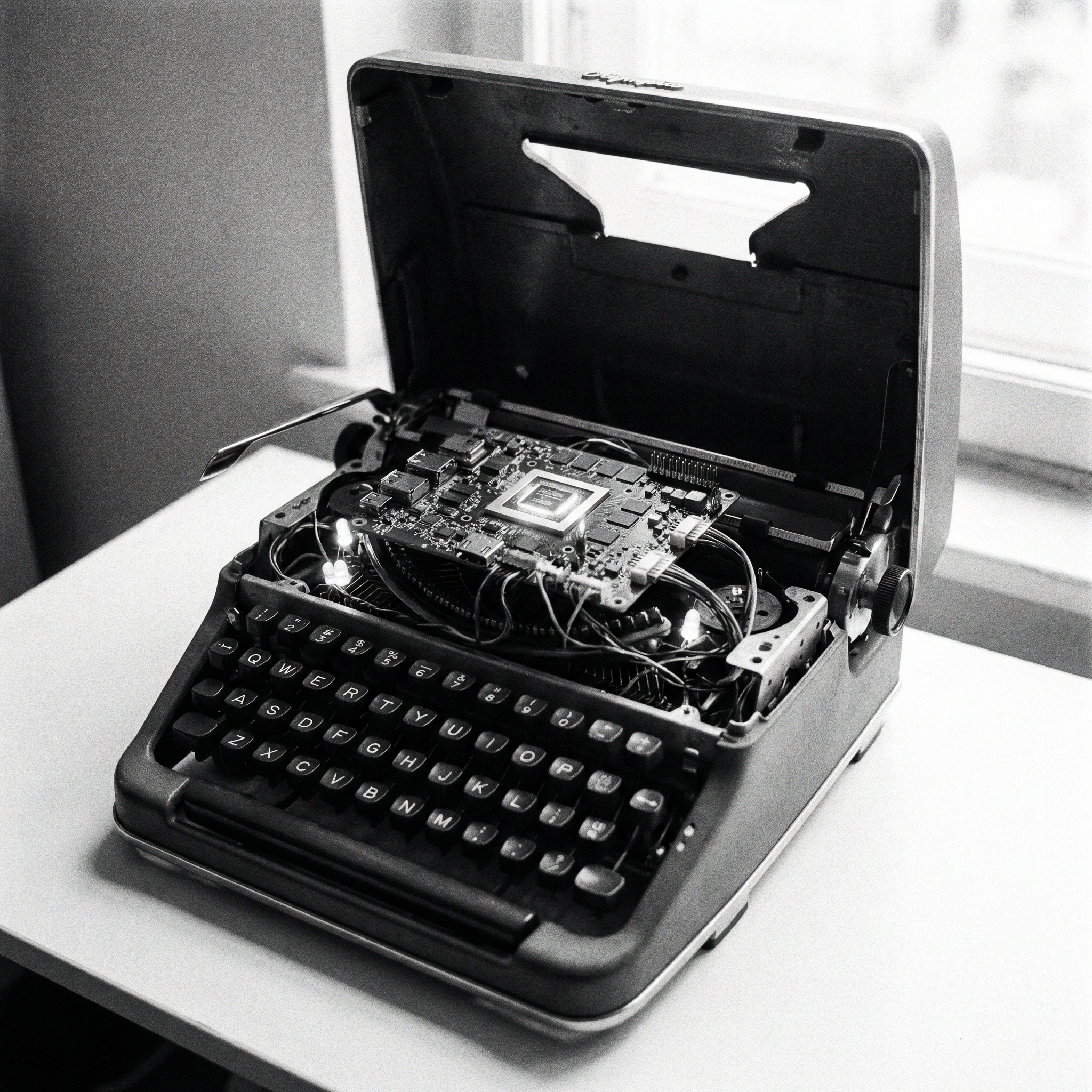

Jest mało rzeczy, które nie zmieniły się przez ostatnie dziesięciolecia, ale jedna owszem – ludzie wciąż nie do końca pojmują, jak właściwie rozumuje sztuczna inteligencja i skąd biorą się decyzje podejmowane przez model. Wszyscy natomiast zda- ją już sobie sprawę, jak kluczowe jest zachowanie bezpieczeństwa systemów AI. Wcześniej często zdarzały się groźne sytuacje, w których modele były atakowane przez złośliwych agentów. Od pewnego czasu na każdym statku musi być obecny także inżynier od bezpieczeństwa AI. Nikt przecież nie chce, by znowu rozległ się alarm, a wszystkie modele zaczęły sygnalizować wykrycie anomalii w każdym możliwym systemie, tak jakby statek za- raz miał się rozpaść. Bywały sytuacje, w których nikomu nie udawało się porozumieć z chatbotami zarządzającymi całym pokładem – były one w stanie jedynie zakomunikować wystąpienie awarii, ale nie wyjaśniały, na czym dokładnie polegał problem ani co go spowodowało.