Twój koszyk jest obecnie pusty!

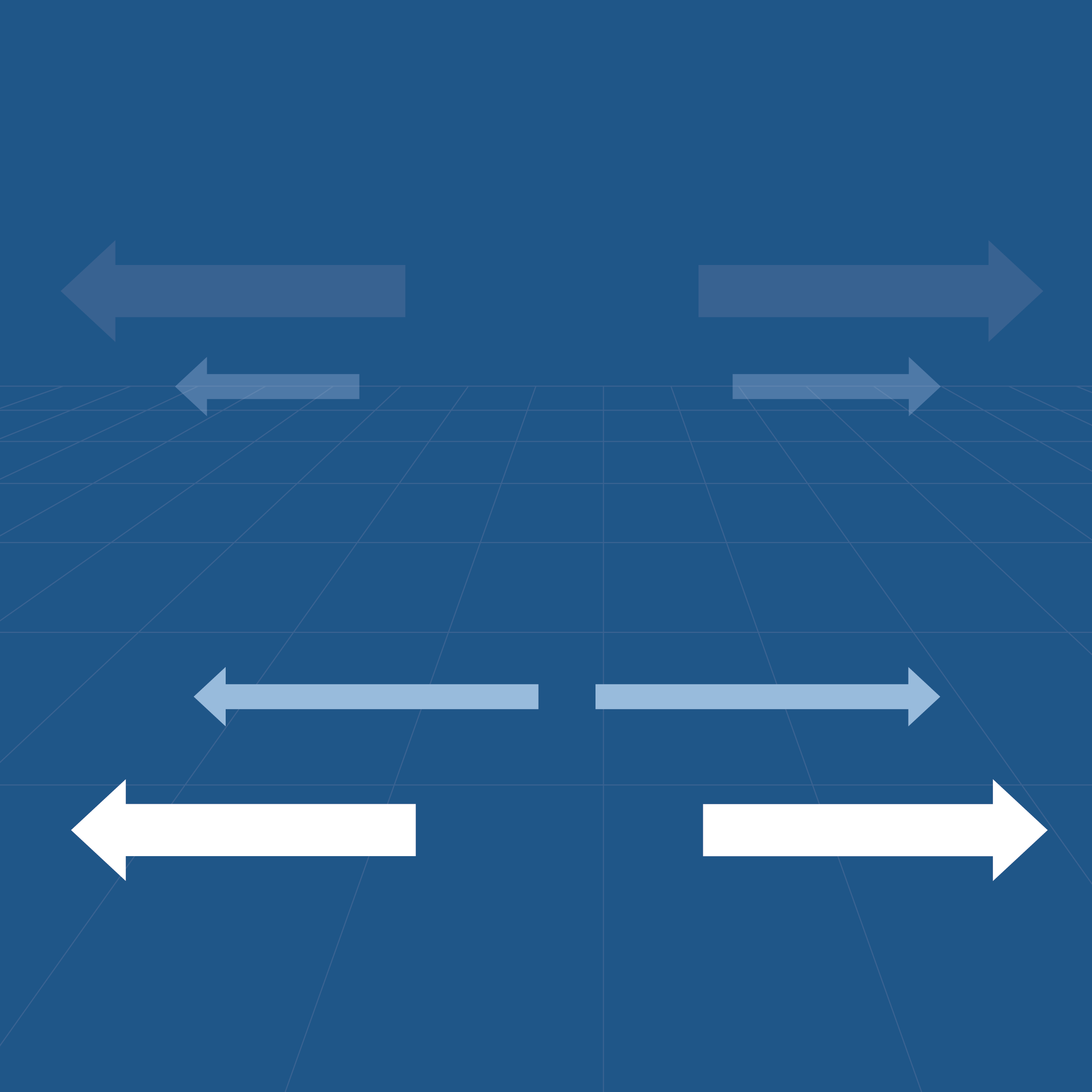

Kiedy mówimy o modelach języka, mamy na myśli przede wszystkim modele generatywne, takie jak GPT, Claude czy Gemini, których zadaniem jest odpowiadanie na pytania, wykonywanie poleceń czy tworzenie treści. Tak naprawdę modelowanie języka nie musi jednak wcale opierać się na generowaniu tekstu, gdyż modelowanie oznacza tutaj opracowanie modelu (matematycznego, probabilistycznego) opisującego język. Gdy przyjrzymy się drzewu genealogicznemu modeli języka, zobaczymy, że dzieli się ono na trzy główne gałęzie. W pierwszej znajdują się doskonale nam znane generatywne modele języka, oparte na dekoderach z architektury transformera, w drugiej z kolei – modele oparte na enkoderach, które nie są nastawione na generowanie tekstu, tylko na tworzenie jego reprezentacji (wektorów słów i zdań). Poprzez naukę nienadzorowaną uczą się „rozumieć” język i umieszczać zdania o podobnym znaczeniu blisko siebie.

Enkodery nie mogą na przykład samodzielnie pełnić funkcji asystenta, ale są elementami większych systemów uczenia maszynowego. Reprezentacje, które tworzą, można wykorzystywać choćby w systemach Retrieval Augmented Generation (RAG), wyszukiwarkach czy systemach rekomendacyjnych, które nie mogłyby działać bez dobrej reprezentacji tekstu. Ponadto są podstawą dla modeli uczenia maszynowego dedykowanych konkretnym zadaniom, takim jak klasyfikacja czy ekstrakcja informacji.